Ceph tiene muy buena prensa en el mundo homelab. Es normal. Sobre el papel suena brillante. Almacenamiento distribuido, replicación, tolerancia a fallos, integración muy seria con Proxmox y la sensación de que estás montando algo que se parece a un entorno de verdad. El problema es que, cuando bajas del PowerPoint al salón de casa, Ceph también te recuerda muy rápido que no le importan tus ilusiones.

Yo no lo digo desde fuera. Lo tengo corriendo en un cluster pequeño de Proxmox y me gusta. De hecho, me sigue pareciendo una de las piezas más potentes que puedes montar en casa si sabes muy bien por qué la estás montando. Pero también creo que muchísima gente lo recomienda demasiado pronto, como si fuera el siguiente paso natural después de instalar tres nodos y aprender a pronunciar “quorum” sin pestañear.

Mi opinión, ya desde el principio, es bastante clara. Ceph merece la pena cuando necesitas de verdad almacenamiento compartido entre varios nodos y aceptas el coste operativo que viene pegado. Si lo quieres solo porque queda bonito en la firma del foro, te va a cobrar cada minuto con intereses.

Por qué acabé montándolo#

En mi caso la razón no fue postureo. Fue necesidad práctica. Cuando empiezas a jugar con un cluster de Proxmox en serio, hay un momento en el que el almacenamiento local deja de ser suficiente. Puedes vivir con discos locales y replicación, sí. Puedes apañarte con backups y restauraciones rápidas, también. Pero si quieres mover cargas entre nodos sin pensar demasiado, o si quieres que la alta disponibilidad tenga sentido sin inventarte demasiadas acrobacias, el almacenamiento compartido empieza a cambiar bastante la película.

Ahí Ceph encaja muy bien. Proxmox lo integra de forma bastante limpia, puedes presentar almacenamiento RBD a todos los nodos, y la experiencia de gestión es mucho mejor que tirar de parches improvisados con NFS mal afinado o soluciones a medio cocer.

Eso sí, el truco está en esa frase que casi nadie subraya lo suficiente: “cuando encaja”.

Ceph no es un comodín universal. Es una decisión de arquitectura. Si te equivocas, no solo no te arregla el homelab, también te añade una capa entera de trabajo nuevo.

Lo que la documentación acierta al decirte#

La parte buena es que la documentación oficial de Ceph y Proxmox no miente demasiado. Proxmox deja bastante claro que, si buscas un cluster serio con quorum fiable, quieres al menos tres nodos. Ceph, por su parte, tampoco es tímido con el tema de la salud del cluster. Si algo está mal, te lo dice. A veces con mucha insistencia, que también tiene su encanto.

Hay varias ideas que conviene tomarse en serio desde el primer día.

La primera es que Ceph vive y muere por la red. No necesita una barbaridad de ancho de banda para cada operación pequeña, pero sí necesita baja latencia y estabilidad. Si montas esto sobre una red doméstica con tráfico mezclado, switches reguleros o interfaces que van y vienen, luego no te extrañe que el cluster se ponga melodramático.

La segunda es que el espacio libre importa más de lo que parece. En un NAS casero te acostumbras a llenar discos bastante arriba. En Ceph, sobre todo en clusters pequeños, esa costumbre te lleva directo a los avisos de nearfull, a reequilibrios lentos y a la sensación de que todo se ha vuelto más delicado justo cuando más necesitas que aguante.

La tercera es que las asimetrías se pagan. Discos distintos, pesos distintos, nodos con capacidades muy diferentes, usos mezclados. Todo eso se puede hacer. Otra cosa es que sea buena idea.

Lo que me encuentro en el cluster real#

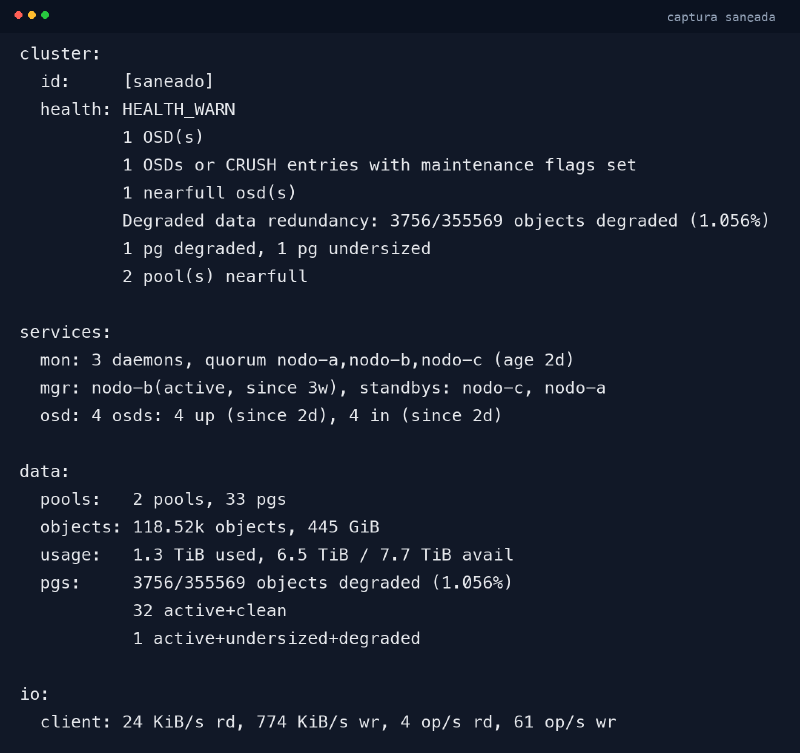

Para no hablar en abstracto, esta es una captura saneada del estado real de mi cluster mientras escribo esto. He cambiado nombres y direcciones, pero los números son de verdad.

Lo interesante aquí no es solo que el cluster esté funcional. Lo interesante es el matiz. Tengo tres monitores en quorum, cuatro OSD activos y unos 445 GiB en objetos. Suena razonable. Aun así, el cluster muestra avisos de nearfull, algo de degradación y una pool que ya va lo bastante apretada como para recordar una lección importante: en Ceph no esperes a estar casi lleno para preocuparte.

Eso es precisamente lo que más cambia mi opinión frente al entusiasmo habitual de internet. En un homelab pequeño, Ceph funciona mejor cuando vas con margen. Margen de red, margen de discos, margen de paciencia. Si intentas llevarlo al límite porque “solo son unos cuantos servicios”, el sistema te enseña muy rápido quién manda.

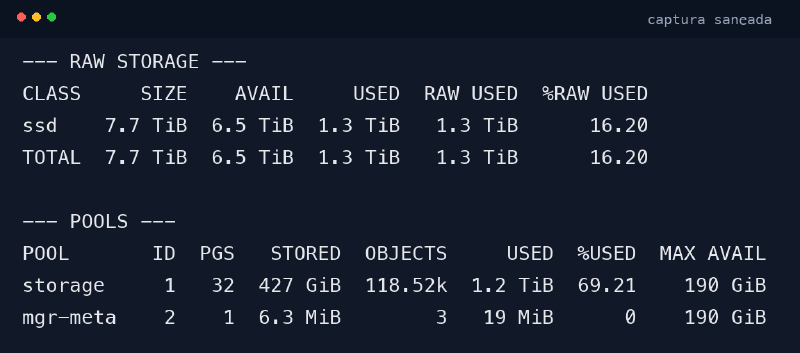

Esta otra captura también es reveladora.

El total bruto del cluster todavía parece cómodo, pero una de las pools ya roza un uso alto para lo que a mí me parece sano en un entorno casero. Esa diferencia entre el total agregado y la realidad operativa de cada pool es justo el tipo de detalle que cuesta aprender si solo lees comparativas optimistas.

Donde Ceph sí compensa#

A pesar de todo lo anterior, no quiero caer en el extremo contrario. Ceph no es un error. Simplemente no es gratis.

Cuando quieres almacenamiento compartido de verdad#

Aquí es donde más brilla. Si tienes varios nodos Proxmox y quieres que las máquinas virtuales o contenedores puedan vivir con relativa normalidad aunque cambie el nodo que las ejecuta, Ceph resuelve un problema real. No uno inventado para entretenerte el fin de semana.

La diferencia entre trabajar con almacenamiento compartido y no tenerlo es muy grande cuando empiezas a usar migraciones, mantenimiento de nodos o grupos de HA. El laboratorio se vuelve mucho más flexible. Puedes apagar un nodo para tocar hardware, reiniciarlo, o mover una carga porque necesitas liberar recursos. Todo eso se siente bastante más adulto.

Cuando el cluster es parte del hobby#

Esto también hay que decirlo sin vergüenza. A veces el objetivo del homelab no es solo alojar servicios. A veces el objetivo es aprender infra distribuida, entender cómo se comporta un sistema de almacenamiento serio y pegarse con problemas que luego te obligan a leer más. Si ese es tu juego, Ceph es una escuela bastante dura, pero muy útil.

Yo he aprendido mucho más de capacidad, reequilibrio, redundancia y tolerancia a fallos usando Ceph en casa que leyendo cien hilos de Reddit donde todo el mundo opina con una soltura sospechosa.

Cuando tu hardware acompaña#

Ceph mejora bastante cuando le das un entorno mínimamente decente. SSDs razonables, red estable, relojes sincronizados, nodos que no son una mezcla surrealista de restos del cajón. No hace falta tener hardware enterprise, pero sí hace falta un poco de respeto por los cimientos.

Si tus tres nodos están equilibrados, con almacenamiento pensado para ello y un uso sensato, la experiencia cambia mucho. Sigue habiendo mantenimiento, claro. Pero pasas de “qué demonios se ha roto ahora” a “vale, esto es trabajo normal de cluster”.

Donde deja de compensar#

Aquí viene la parte que más cuesta escuchar cuando uno está ilusionado.

Si solo quieres alojar cuatro servicios tranquilos#

Si tu objetivo es levantar cuatro VMs, un par de contenedores y dormir bien, Ceph puede ser demasiado. No porque no funcione, sino porque el coste mental no compensa. Hay soluciones mucho más simples para ese escenario. ZFS local con replicación. Un NFS bien montado para cargas ligeras. Backups buenos y restauración rápida. Incluso almacenamiento local puro si aceptas que no todo tiene que sobrevivir a cualquier fallo.

La pregunta correcta no es “¿puedo montar Ceph?”. La pregunta correcta es “¿me está quitando más tiempo del que me devuelve?”.

Si vas justo de capacidad#

Esta es la trampa clásica. Como Ceph agrega capacidad, te relajas. Ves varios discos, miras el total bruto, te vienes arriba. Luego llega la realidad de la replicación, de los umbrales de nearfull y de que en clusters pequeños cualquier desequilibrio pesa más.

Yo cada vez lo tengo más claro. En homelab, Ceph agradece ir sobrado. Si vas justo desde el principio, acabarás haciendo malabares antes de que el proyecto haya madurado de verdad.

Si te molestan los sistemas que avisan mucho#

Ceph te habla. Mucho. Y normalmente cuando tiene una preocupación, no se la guarda.

A mí esto no me molesta demasiado porque prefiero un sistema pesado pero honesto. Pero hay gente que busca una infraestructura más silenciosa, más invisible, más doméstica. Si eres de esos, ojo. Ceph tiene carácter. Y no precisamente uno relajado.

Si cada nodo es de su padre y de su madre#

La heterogeneidad se puede gestionar, pero cuesta. Un cluster pequeño con discos de tamaños muy diferentes, pesos muy desiguales y nodos con perfiles raros se vuelve más difícil de afinar. No siempre rompe nada. Pero complica decisiones, complica expectativas y complica la lectura de problemas.

En un entorno enterprise eso se compensa con más hardware, más margen y más disciplina. En casa, normalmente se compensa con café y cabezonería.

Lo que haría distinto si empezara hoy#

Lo primero sería reservar mucho más margen de almacenamiento. Más del que te pide tu optimismo inicial. Más del que te dice tu yo de domingo. Ceph en pequeño no perdona bien las sorpresas de capacidad.

Lo segundo sería definir mejor qué merece ir a Ceph y qué no. No todo tiene que vivir en almacenamiento distribuido. Hay cargas que agradecen discos locales, hay servicios que con backup van sobrados y hay inventos que simplemente no necesitan esa complejidad.

Lo tercero sería asumir desde el principio que Ceph necesita observación continua. No en plan paranoico, pero sí con disciplina. Mirar salud del cluster, mirar uso por pool, mirar reequilibrio, mirar estado de OSD. Si eso te da pereza antes de empezar, mejor detectarlo pronto.

Qué alternativas valoro más de lo que valoraba antes#

Esto quizá sea lo que más ha cambiado en mi forma de pensar. Antes veía muchas alternativas a Ceph como soluciones provisionales. Ahora las veo como opciones perfectamente válidas para un montón de homelabs.

ZFS con replicación entre nodos me parece mucho más interesante hoy que hace un tiempo. No te da exactamente lo mismo, pero para muchas cargas es suficiente y te deja una capa menos de complejidad.

Proxmox Backup Server también gana mucho peso cuando maduras un poco. Un buen sistema de backup, con restauraciones rápidas y asumidas como parte normal del flujo, a veces te da más paz que perseguir la disponibilidad absoluta en un laboratorio pequeño.

Y luego está la opción menos glamourosa de todas, que curiosamente suele funcionar bastante bien: no intentar resolver con arquitectura un problema que en realidad es de expectativas.

Mi recomendación honesta#

Yo sí montaría Ceph en un homelab cuando se cumplan varias condiciones.

- Tienes al menos tres nodos serios.

- Necesitas almacenamiento compartido de verdad.

- Aceptas dedicar tiempo a vigilar salud y capacidad.

- Quieres aprender cómo se comporta un sistema distribuido de verdad.

Yo no lo montaría, o no lo montaría todavía, si estás en uno de estos escenarios.

- Tu laboratorio es pequeño y bastante estable.

- Vas justo de discos o de red.

- Solo buscas publicar servicios sin complicarte la vida.

- Te irrita cualquier capa extra de operación.

No pasa nada por admitir que tu homelab no necesita Ceph. De hecho, a menudo me parece un diagnóstico bastante sensato.

La conclusión a la que he llegado#

Ceph no es una compra impulsiva, es un compromiso. Cuando encaja, el resultado es muy bueno. Poder tener almacenamiento compartido entre nodos Proxmox y trabajar con esa flexibilidad mola mucho. Hay una sensación de solidez muy real cuando haces mantenimiento, mueves cargas o sobrevives a fallos sin tener que reconstruir media casa.

Pero también he aprendido que Ceph exige algo a cambio. Exige hardware coherente, margen de capacidad, una red decente y ganas de estar encima. En un homelab grande o en uno muy orientado a aprender infra, ese trato me parece razonable. En un homelab pequeño que solo quiere servir cosas útiles y no llamar demasiado la atención, muchas veces no compensa.

Si me preguntas hoy, mi respuesta sería esta. Monta Ceph cuando el problema sea real y la motivación también. No lo montes solo porque parece el siguiente nivel. En casa, el siguiente nivel a veces no es más distribuido. A veces es simplemente más pesado.

Y bastante tenemos ya con nuestras propias ideas brillantes como para añadir otra que además grita cuando se queda sin espacio.

Referencias#

- Cluster Manager de Proxmox

- Ceph health checks

- Troubleshooting OSDs en Ceph

- Post relacionado: Proxmox HA: alta disponibilidad para tus VMs sin infraestructura enterprise

- Post relacionado: ZFS snapshots: el sistema de backups que deberías usar en tu homelab

- Post relacionado: Proxmox Backup Server: copias de seguridad para tu homelab